ปัญญาประดิษฐ์จะล่มสลายได้หรือไม่? ผู้เชี่ยวชาญเตือนเกี่ยวกับอันตรายและแนวทางแก้ไข

ทำไมปัญญาประดิษฐ์เชิงสร้างสรรค์จึงอาจทำลายตัวเองได้? ค้นคว้างานวิจัยล่าสุดที่เตือนเกี่ยวกับการเสื่อมสภาพของมัน และผู้เชี่ยวชาญที่วิเคราะห์แนวทางแก้ไขที่เป็นไปได้...ผู้เขียน: Patricia Alegsa

14-10-2024 14:21

สารบัญ

- สัญญาณเตือนเกี่ยวกับการเสื่อมสภาพของปัญญาประดิษฐ์เชิงสร้างสรรค์

- การล่มสลายของโมเดล: ปรากฏการณ์เสื่อมสภาพ

- ความยากลำบากในการแทรกแซงของมนุษย์

- อนาคตที่ไม่แน่นอน: ความท้าทายและแนวทางแก้ไขที่เป็นไปได้

สัญญาณเตือนเกี่ยวกับการเสื่อมสภาพของปัญญาประดิษฐ์เชิงสร้างสรรค์

งานวิจัยล่าสุดได้จุดประกายสัญญาณเตือนเกี่ยวกับปรากฏการณ์ที่น่ากังวลในการพัฒนาปัญญาประดิษฐ์เชิงสร้างสรรค์: การเสื่อมคุณภาพของคำตอบ

ผู้เชี่ยวชาญได้ชี้ว่าเมื่อระบบเหล่านี้ถูกฝึกด้วยข้อมูลสังเคราะห์ หรือก็คือเนื้อหาที่สร้างขึ้นโดยปัญญาประดิษฐ์อื่น ๆ ระบบอาจตกอยู่ในวงจรของการเสื่อมสภาพจนส่งผลให้คำตอบกลายเป็นเรื่องไร้สาระและไม่มีความหมาย

คำถามที่เกิดขึ้นคือ: เราจะมาถึงจุดนี้ได้อย่างไร และมีมาตรการใดบ้างที่สามารถนำมาใช้ป้องกันได้?

“การล่มสลายของโมเดล” หมายถึงกระบวนการที่ระบบปัญญาประดิษฐ์ติดอยู่ในวงจรการฝึกด้วยข้อมูลคุณภาพต่ำ ส่งผลให้สูญเสียความหลากหลายและประสิทธิภาพ

การล่มสลายของโมเดล: ปรากฏการณ์เสื่อมสภาพ

“การล่มสลายของโมเดล” หมายถึงกระบวนการที่ระบบปัญญาประดิษฐ์ติดอยู่ในวงจรการฝึกด้วยข้อมูลคุณภาพต่ำ ส่งผลให้สูญเสียความหลากหลายและประสิทธิภาพ

ตามที่ Ilia Shumailov ผู้ร่วมเขียนงานวิจัยที่ตีพิมพ์ในวารสาร Nature ระบุ ปรากฏการณ์นี้เกิดขึ้นเมื่อปัญญาประดิษฐ์เริ่มใช้ผลลัพธ์ของตัวเองเป็นข้อมูลป้อนกลับ ทำให้เกิดอคติซ้ำซากและลดทอนประโยชน์ใช้งานในระยะยาว ซึ่งอาจนำไปสู่การที่โมเดลผลิตเนื้อหาที่เหมือนกันมากขึ้นและแม่นยำน้อยลง เหมือนเสียงสะท้อนของคำตอบของตัวเอง

Emily Wenger อาจารย์วิศวกรรมศาสตร์จากมหาวิทยาลัย Duke อธิบายปัญหานี้ด้วยตัวอย่างง่าย ๆ ว่า หากปัญญาประดิษฐ์ถูกฝึกให้สร้างภาพสุนัข มันจะมีแนวโน้มที่จะทำซ้ำพันธุ์ที่พบได้บ่อย โดยละเลยพันธุ์ที่ไม่ค่อยเป็นที่รู้จัก

Emily Wenger อาจารย์วิศวกรรมศาสตร์จากมหาวิทยาลัย Duke อธิบายปัญหานี้ด้วยตัวอย่างง่าย ๆ ว่า หากปัญญาประดิษฐ์ถูกฝึกให้สร้างภาพสุนัข มันจะมีแนวโน้มที่จะทำซ้ำพันธุ์ที่พบได้บ่อย โดยละเลยพันธุ์ที่ไม่ค่อยเป็นที่รู้จัก

นี่ไม่เพียงแต่สะท้อนถึงคุณภาพของข้อมูลเท่านั้น แต่ยังสร้างความเสี่ยงอย่างมีนัยสำคัญต่อการเป็นตัวแทนของชนกลุ่มน้อยในชุดข้อมูลฝึกอบรมด้วย

อ่านเพิ่มเติม: ปัญญาประดิษฐ์ที่ฉลาดขึ้นเรื่อย ๆ และมนุษย์ที่โง่ลงเรื่อย ๆ.

แม้ว่าสถานการณ์จะรุนแรง แต่การแก้ไขไม่ใช่เรื่องง่าย Shumailov ชี้ว่า ยังไม่ชัดเจนว่าจะหลีกเลี่ยงการล่มสลายของโมเดลได้อย่างไร แม้ว่าจะมีหลักฐานว่าการผสมผสานข้อมูลจริงกับข้อมูลสังเคราะห์อาจช่วยบรรเทาผลกระทบนี้ได้

อ่านเพิ่มเติม: ปัญญาประดิษฐ์ที่ฉลาดขึ้นเรื่อย ๆ และมนุษย์ที่โง่ลงเรื่อย ๆ.

ความยากลำบากในการแทรกแซงของมนุษย์

แม้ว่าสถานการณ์จะรุนแรง แต่การแก้ไขไม่ใช่เรื่องง่าย Shumailov ชี้ว่า ยังไม่ชัดเจนว่าจะหลีกเลี่ยงการล่มสลายของโมเดลได้อย่างไร แม้ว่าจะมีหลักฐานว่าการผสมผสานข้อมูลจริงกับข้อมูลสังเคราะห์อาจช่วยบรรเทาผลกระทบนี้ได้

อย่างไรก็ตาม นั่นก็หมายถึงต้นทุนการฝึกอบรมที่สูงขึ้นและความยากลำบากในการเข้าถึงชุดข้อมูลที่ครบถ้วนมากขึ้นด้วย

การขาดแนวทางที่ชัดเจนสำหรับการแทรกแซงของมนุษย์ทำให้ผู้พัฒนาต้องเผชิญกับทางเลือกที่ยากลำบาก: มนุษย์จะสามารถควบคุมอนาคตของปัญญาประดิษฐ์เชิงสร้างสรรค์ได้จริงหรือ?

Fredi Vivas ซีอีโอของ RockingData เตือนว่าการฝึกอบรมด้วยข้อมูลสังเคราะห์มากเกินไปอาจสร้าง “เอฟเฟกต์ห้องสะท้อนเสียง” ซึ่งปัญญาประดิษฐ์เรียนรู้จากความไม่แม่นยำของตัวเอง ทำให้ความสามารถในการสร้างเนื้อหาที่แม่นยำและหลากหลายลดลงอีก ดังนั้นคำถามเกี่ยวกับวิธีรับประกันคุณภาพและประโยชน์ใช้สอยของโมเดลปัญญาประดิษฐ์จึงกลายเป็นเรื่องเร่งด่วนมากขึ้นเรื่อย ๆ

อนาคตที่ไม่แน่นอน: ความท้าทายและแนวทางแก้ไขที่เป็นไปได้

ผู้เชี่ยวชาญเห็นพ้องกันว่าการใช้ข้อมูลสังเคราะห์ไม่ใช่เรื่องเลวร้ายโดยเนื้อแท้ แต่การจัดการต้องใช้แนวทางที่รับผิดชอบ ข้อเสนอเช่นการติดตั้งเครื่องหมายลายน้ำในข้อมูลที่สร้างขึ้นอาจช่วยระบุและกรองเนื้อหาสังเคราะห์ เพื่อรับประกันคุณภาพในการฝึกอบรมโมเดลปัญญาประดิษฐ์

อย่างไรก็ตาม ประสิทธิผลของมาตรการเหล่านี้ขึ้นอยู่กับความร่วมมือระหว่างบริษัทเทคโนโลยีขนาดใหญ่และผู้พัฒนาโมเดลขนาดเล็กกว่า

อนาคตของปัญญาประดิษฐ์เชิงสร้างสรรค์กำลังตกอยู่ในความเสี่ยง และชุมชนวิทยาศาสตร์กำลังแข่งขันกับเวลาเพื่อค้นหาแนวทางแก้ไขก่อนที่ฟองสบู่ของเนื้อหาสังเคราะห์จะระเบิด

อนาคตของปัญญาประดิษฐ์เชิงสร้างสรรค์กำลังตกอยู่ในความเสี่ยง และชุมชนวิทยาศาสตร์กำลังแข่งขันกับเวลาเพื่อค้นหาแนวทางแก้ไขก่อนที่ฟองสบู่ของเนื้อหาสังเคราะห์จะระเบิด

กุญแจสำคัญคือการสร้างกลไกที่แข็งแกร่งเพื่อรับประกันว่าโมเดลปัญญาประดิษฐ์จะยังคงมีประโยชน์และแม่นยำ หลีกเลี่ยงการล่มสลายที่หลายคนหวาดกลัว

มังกร ราศีกรกฎ ราศีกันย์ ราศีกุมภ์ ราศีตุลย์ ราศีธนู ราศีพฤษภ ราศีพิจิก ราศีมีน ราศีสิงห์ ราศีเมถุน ราศีเมษ

-

ทำไมเครื่องบินจึงหลีกเลี่ยงการบินข้ามทิเบต?

ทำไมเครื่องบินจึงหลีกเลี่ยงการบินข้ามทิเบต?

ค้นพบเหตุผลที่เครื่องบินหลีกเลี่ยงการบินข้ามทิเบต ซึ่งเป็นภูมิภาคที่มีความสูงกว่า 4,500 เมตร ทำให้การบินพาณิชย์ซับซ้อนขึ้น -

น่าอัศจรรย์: การบำบัดกระตุ้นสมองที่ทำได้ที่บ้านช่วยบรรเทาอาการซึมเศร้าได้

น่าอัศจรรย์: การบำบัดกระตุ้นสมองที่ทำได้ที่บ้านช่วยบรรเทาอาการซึมเศร้าได้

การบำบัดกระตุ้นสมองที่ทำได้ที่บ้านใหม่ล่าสุด ซึ่งได้รับการทดสอบโดย King’s College ลอนดอน มอบความหวังให้กับผู้ที่ไม่ดีขึ้นจากการใช้ยาและจิตบำบัด -

วิดีโอ: กำลังนอนหลับอย่างสงบเมื่อเกือบถูกรถชน

วิดีโอ: กำลังนอนหลับอย่างสงบเมื่อเกือบถูกรถชน

ชายหนุ่มคนนี้ต้องเผชิญกับฝันร้ายอย่างแท้จริงบนท้องถนนขณะที่เขากำลังนอนหลับอย่างสงบ และเกือบถูกรถยนต์ที่ขับออกนอกเส้นทางชน -

การทะเลาะวิวาทอย่างรุนแรงในคอนเสิร์ตของแบด บันนี่!

การทะเลาะวิวาทอย่างรุนแรงในคอนเสิร์ตของแบด บันนี่!

การทะเลาะวิวาทอย่างรุนแรงเกิดขึ้นขณะที่นักร้องแบด บันนี่ กำลังร้องเพลงสดในหนึ่งในคอนเสิร์ตของเขาในสหรัฐอเมริกา -

ราล์ฟ มัคคีโอ ในวัย 62 ปี เขาทำอย่างไรถึงดูเด็กอย่างนี้?

ราล์ฟ มัคคีโอ ในวัย 62 ปี เขาทำอย่างไรถึงดูเด็กอย่างนี้?

ราล์ฟ มัคคีโอ ในวัย 62 ปี ดาวเด่นจาก Karate Kid และ Cobra Kai ทำให้ทุกคนประหลาดใจกับรูปลักษณ์ที่ดูอ่อนเยาว์ของเขา ค้นพบความลับและมรดกทางครอบครัวของเขา!

ฉันคือ Patricia Alegsa

ฉันเขียนบทความเกี่ยวกับดวงชะตาและการช่วยเหลือตนเองอย่างมืออาชีพมานานกว่า 20 ปีแล้ว

สมัครรับดวงชะตารายสัปดาห์ฟรี

รับดวงชะตารายสัปดาห์และบทความใหม่ๆ ของเราเกี่ยวกับความรัก ครอบครัว การงาน ความฝัน และข่าวสารอื่นๆ ทางอีเมลของคุณ เราไม่ส่งสแปม

การวิเคราะห์ทางโหราศาสตร์และตัวเลข

-

นักแปลความฝันออนไลน์: ด้วยปัญญาประดิษฐ์

นักแปลความฝันออนไลน์: ด้วยปัญญาประดิษฐ์

คุณต้องการรู้ความหมายของความฝันที่คุณเคยมีหรือไม่? ค้นพบพลังในการเข้าใจความฝันของคุณด้วยนักแปลความฝันออนไลน์ขั้นสูงของเราที่ใช้ปัญญาประดิษฐ์ ซึ่งจะตอบคุณภายในไม่กี่วินาที

นักแปลความฝันออนไลน์: ด้วยปัญญาประดิษฐ์

นักแปลความฝันออนไลน์: ด้วยปัญญาประดิษฐ์

คุณต้องการรู้ความหมายของความฝันที่คุณเคยมีหรือไม่? ค้นพบพลังในการเข้าใจความฝันของคุณด้วยนักแปลความฝันออนไลน์ขั้นสูงของเราที่ใช้ปัญญาประดิษฐ์ ซึ่งจะตอบคุณภายในไม่กี่วินาที

-

ค้นพบลีอันโดร ปาเรเดส นักฟุตบอลสุดเซ็กซี่

ค้นพบลีอันโดร ปาเรเดส นักฟุตบอลสุดเซ็กซี่

ลีอันโดร ปาเรเดส: นักฟุตบอลชาวอาร์เจนตินาและแชมป์: ลีอันโดร ปาเรเดสไม่เพียงแต่โดดเด่นในสนามฟุตบอลเท่านั้น แต่ยังโดดเด่นด้วยดวงตาสีฟ้าที่ดึงดูดใจและเสน่ห์นอกสนามอีกด้วย -

บรูซ ลินดาห์ล: ฆาตกรต่อเนื่องและความลับมืดมนที่ถูกเปิดเผย

บรูซ ลินดาห์ล: ฆาตกรต่อเนื่องและความลับมืดมนที่ถูกเปิดเผย

ค้นพบเรื่องราวมืดมนของบรูซ ลินดาห์ล ฆาตกรต่อเนื่องผู้มีสายตาที่ดึงดูดใจ ซึ่งเสียชีวิตพร้อมกับเหยื่อรายสุดท้ายของเขา ความลับและอาชญากรรมที่ถูกเปิดเผยหลังผ่านไปหลายสิบปี -

โควิด-19: การเพิ่มขึ้นของจำนวนผู้ป่วยและอาการที่ยังคงอยู่ซึ่งทำให้องค์การอนามัยโลกเป็นกังวล

โควิด-19: การเพิ่มขึ้นของจำนวนผู้ป่วยและอาการที่ยังคงอยู่ซึ่งทำให้องค์การอนามัยโลกเป็นกังวล

โควิด-19 ยังคงเป็นภัยคุกคาม: องค์การอนามัยโลกเตือนเกี่ยวกับการเพิ่มขึ้นของจำนวนผู้ป่วยและอาการที่ยังคงอยู่ซึ่งส่งผลกระทบต่อผู้คนนับล้าน รับข้อมูลเพิ่มเติมที่นี่! -

ทำไมเวลาถึงผ่านไปเร็วเมื่อเราแก่ตัวลง? ค้นพบวิทยาศาสตร์เบื้องหลังเรื่องนี้

ทำไมเวลาถึงผ่านไปเร็วเมื่อเราแก่ตัวลง? ค้นพบวิทยาศาสตร์เบื้องหลังเรื่องนี้

ค้นพบว่าทำไมปีจึงผ่านไปอย่างรวดเร็วเมื่อเราแก่ตัวลง: จิตวิทยาและประสาทวิทยาศาสตร์เผยให้เห็นว่าการเผาผลาญอาหาร กิจวัตรประจำวัน และประสบการณ์ต่างๆ มีอิทธิพลต่อการรับรู้เวลาของเราอย่างไร -

น่าเหลือเชื่อ!: ใช้ปัญญาประดิษฐ์ในการติดตามประสิทธิภาพการทำงานของพนักงาน

น่าเหลือเชื่อ!: ใช้ปัญญาประดิษฐ์ในการติดตามประสิทธิภาพการทำงานของพนักงาน

วิดีโอที่กลายเป็นไวรัลในช่วงไม่กี่ชั่วโมงที่ผ่านมาแสดงให้เห็นว่าใช้ปัญญาประดิษฐ์ในการติดตามพนักงานได้ทันที ชมวิดีโอที่น่าเหลือเชื่อนี้! -

สร้างแบตเตอรี่ปุ่มนิวเคลียร์ที่มีพลังงานใช้งานได้ 100 ปี

สร้างแบตเตอรี่ปุ่มนิวเคลียร์ที่มีพลังงานใช้งานได้ 100 ปี

อินฟินิตี้ พาวเวอร์ เปิดตัวแบตเตอรี่ปุ่มนิวเคลียร์ที่มีความจุพลังงานใช้งานได้ถึง 100 ปี! -

ผู้ตามติดตัวจริงจากซีรีส์ฮิตของ Netflix ให้สัมภาษณ์

ผู้ตามติดตัวจริงจากซีรีส์ฮิตของ Netflix ให้สัมภาษณ์

ผู้ตามติดตัวจริงในชีวิตจริง ชื่อมาร์ธา ในซีรีส์ฮิตของ Netflix ให้สัมภาษณ์กับเพียร์ส มอร์แกน ซึ่งสร้างความคาดหวังอย่างมากทั่วโลก -

ความหมายของการฝันเห็นผีหรือวิญญาณคืออะไร?

ความหมายของการฝันเห็นผีหรือวิญญาณคืออะไร?

ค้นหาความหมายเบื้องหลังความฝันที่น่ากังวลที่สุดของคุณ การฝันเห็นผีหรือวิญญาณหมายความว่าอย่างไร? ค้นหาคำตอบได้ในบทความของเรา ห้ามพลาด! -

ความหมายของการฝันเห็นบ้านน้ำแข็ง (อิกลู) คืออะไร?

ความหมายของการฝันเห็นบ้านน้ำแข็ง (อิกลู) คืออะไร?

ค้นพบโลกที่น่าหลงใหลของการตีความความฝันและความหมายเบื้องหลังการฝันเห็นบ้านน้ำแข็ง (อิกลู) ค้นหาคำตอบและคำแนะนำเพื่อก้าวต่อไปในชีวิตของคุณ -

ความหมายของการฝันเห็นกระสุนปืนคืออะไร?

ความหมายของการฝันเห็นกระสุนปืนคืออะไร?

ค้นหาความหมายที่แท้จริงของการฝันเห็นกระสุนปืนในบทความนี้ และวิธีที่ความฝันนี้อาจเกี่ยวข้องกับชีวิตปัจจุบันและอนาคตของคุณ -

ความหมายของการฝันเห็นการพายเรือคายัคคืออะไร?

ความหมายของการฝันเห็นการพายเรือคายัคคืออะไร?

ค้นหาความหมายเบื้องหลังความฝันเกี่ยวกับการพายเรือคายัค การพายเรือคายัคหมายถึงการเดินทางที่น่าตื่นเต้นหรือความต้องการที่จะไหลไปกับชีวิตหรือไม่? ค้นหาคำตอบได้ที่นี่ -

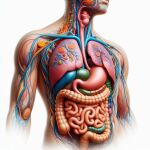

การวินิจฉัยมะเร็งลำไส้ใหญ่ในวัยรุ่นเพิ่มขึ้น: อาหารแปรรูปสูงตกเป็นผู้ต้องสงสัย

การวินิจฉัยมะเร็งลำไส้ใหญ่ในวัยรุ่นเพิ่มขึ้น: อาหารแปรรูปสูงตกเป็นผู้ต้องสงสัย

มะเร็งลำไส้ใหญ่ในผู้ที่มีอายุต่ำกว่า 50 ปีเพิ่มขึ้น: อาหารและอาหารแปรรูปสูงอยู่ภายใต้การตรวจสอบ ผู้เชี่ยวชาญเตือน: พฤติกรรมปัจจุบันเพิ่มความเสี่ยง -

ทำไมคุณถึงไม่ไว้วางใจใคร ตามราศีของคุณ

ทำไมคุณถึงไม่ไว้วางใจใคร ตามราศีของคุณ

นี่คือสิ่งที่ทำให้แต่ละราศีตัดสินใจที่จะไม่ไว้วางใจใคร